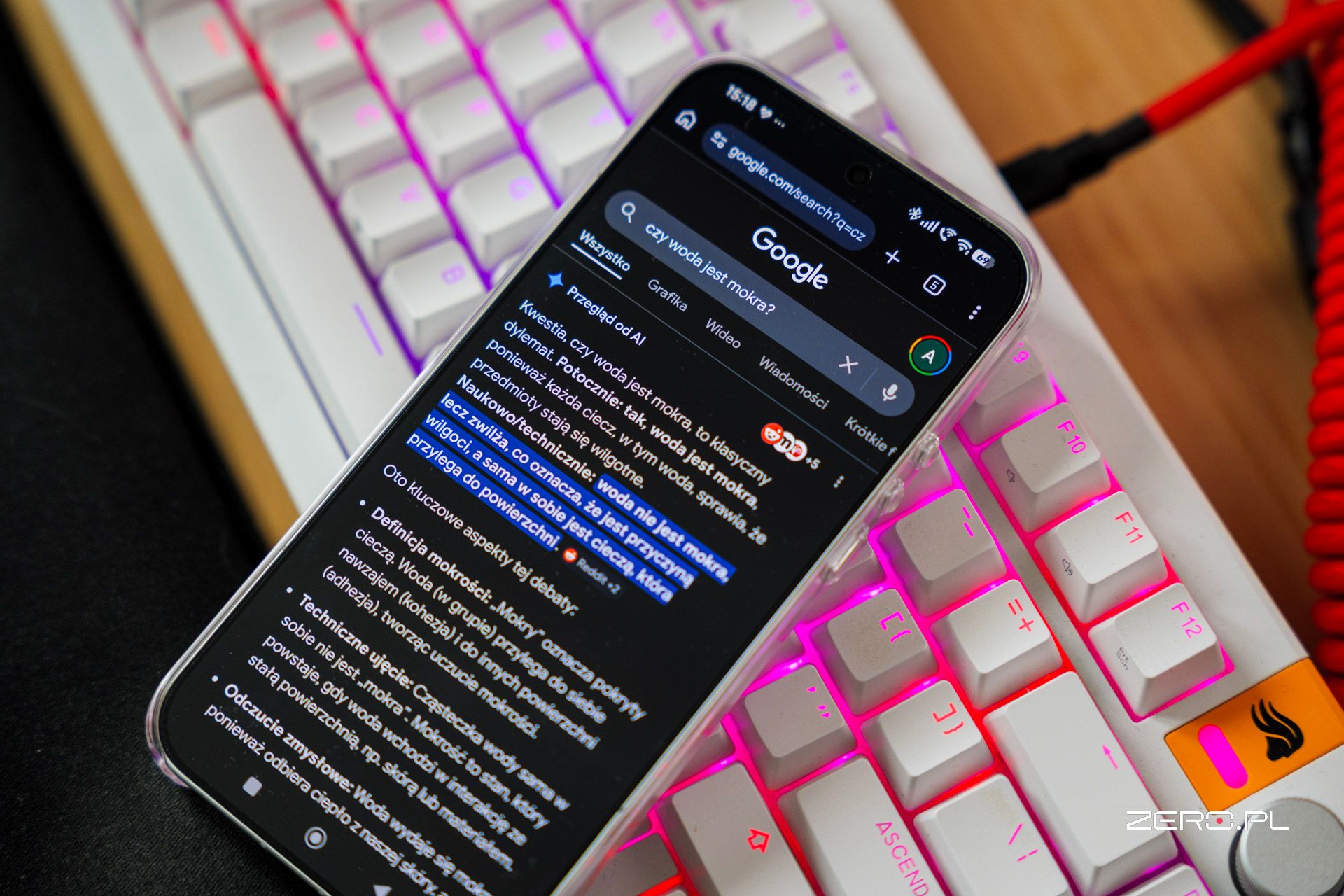

Od pewnego czasu na pytania zadane w wyszukiwarce Google odpowiada nam Gemini. Z dokładnością odpowiedzi bywa różnie, choć działanie modelu uległo znacznej poprawie. Ich poprawność w ujęciu procentowym jest wysoka, ale jednocześnie Google potrafi skłamać nawet 500 mld razy rocznie. Wszystko zależy od skali.

- Dziennikarze New York Times sprawdzili, jak wygląda skuteczność odpowiedzi udzielanych przez Gemini w wyszukiwarce Google.

- Skuteczność odpowiedzi z jednej strony wygląda dobrze, bo poprawiła się z 85 proc. do 91 proc.

- Biorąc pod uwagę liczbę zapytań w skali roku, Google może mylić się nawet 500 mld razy rocznie.

W 2024 r. Google zaczął udzielać odpowiedzi na zadane w wyszukiwarce pytania za pomocą modelu Gemini w ramach AI Overviews. Widzimy je na szczycie listy. Gdybym miał ocenić działanie i skuteczność odpowiedzi wyłącznie na podstawie własnych doświadczeń, byłoby to solidne 2/10. W zasadzie to był powód, dla którego zacząłem korzystać z wyszukiwarki znacznie rzadziej. Badania pokazują, że Google poprawia się i dzisiaj udziela znacznie lepszych odpowiedzi.

Gemini udziela prawidłowych odpowiedzi w ponad 90 proc. pytań. To dużo, czy mało?

Dokładność odpowiedzi udzielanych przez Google jest przedmiotem sporu. Trudno powiedzieć, co należy uznać za poprawną odpowiedź. Czy jest to faktyczna informacja przekazana przez Gemini na górze strony wyszukiwania, czy wystarczy podanie konkretnego linku, pod którym znajdziemy odpowiedź?

Na zlecenie redakcji New York Times sprawie przyjrzał się startup Oumi, zajmujący się działaniem sztucznej inteligencji. Wykorzystano do tego popularny test porównawczy SimpleQA, którego używa się do pomiaru dokładności systemów AI. Test przeprowadzono dwukrotnie - w październiku 2025 r. na modelu Gemini 2, oraz w lutym 2026 r. na Gemini 3.

W ramach testu przeprowadzono 4 326 wyszukiwań w Google. W przypadku Gemini 2 skuteczność odpowiedzi wynosiła 85 proc., a w Gemini 3 91 proc.. To znaczący wzrost i patrząc na to, że Google udziela poprawnych odpowiedzi na 9 z 10 zadanych pytań – wygląda to dobrze.

Z drugiej strony, jeśli spojrzymy na to, że do Google trafia ponad 5 bln zapytań rocznie, błędne odpowiedzi przydarzają się w przypadku 500 mld z nich. A to nieco zmienia perspektywę.

AI kłamie, bo korzysta ze złych źródeł. Media społecznościowe źródłem fałszywych informacji?

Z wynikami testu przeprowadzonego przez Oumi nie zgadza się Google. Według firmy analiza jest wadliwa, bo test porównawczy został stworzony przez OpenAI i zawiera „poważne luki”. Trudno było się spodziewać innej odpowiedzi.

Co ciekawe, Google opublikował wyniki własnego testu, według którego AI Overview wypadło znacznie gorzej. Przy wykorzystaniu Gemini 3 błędy zdarzały się w przypadku 28 proc. odpowiedzi.

Badanie pokazało jednak ciekawy schemat. Jako jeden z przykładów podana została odpowiedź na pytanie – kiedy dom Boba Marleya przekształcono w muzeum. W rzeczywistości było to w 1986 roku, natomiast Gemini odpowiedział, że w 1987. Jest to informacja błędna, ale zgodna ze źródłem. Tymi była – Wikipedia z podanymi dwoma datami (1986 i 1987), strona bloga podróżniczego z błędną datą oraz profil na Facebooku córki Boba Marleya, gdzie były zdjęcia muzeum, ale bez podanej daty.

Wśród błędnych odpowiedzi pojawił się pewien schemat. W przypadku pytań, na które udzielona została nieprawidłowa odpowiedź, 7 proc. cytowanych źródeł pochodziło z Facebooka. W przypadku poprawnych było to 5 proc.

AI może udzielać odpowiedzi na podstawie stron internetowych, które tych odpowiedzi nie zawierają

To problem nie tylko Google, czyli odpowiedzi udzielane na podstawie linku, który tej odpowiedzi... nie udziela. Spotykam się z tym dosyć często i to też potwierdza analiza Oumi. Co może dziwić, w przypadku Gemini 3 ten problem występował częściej, niż w starszym modelu Gemini 2.

Wynika to prawdopodobnie z tego, że AI stara się być bardziej samodzielna, co nie zawsze jest dobrym rozwiązaniem. Wyniki własnych testów Google pokazały, że odpowiedzi w AI Overview bazujące na wynikach wyszukiwania są dokładniejsze niż te, w których Gemini próbował znaleźć odpowiedź na własną rękę, przeszukując różne źródła.

Dlatego też musimy o tym pamiętać, kiedy wyszykujemy informacji za pomocą AI. Algorytmy nie są w stanie zweryfikować niektórych informacji. Dziennikarze New York Times podają tu bardzo ważny przykład. Jeśli stworzymy bloga, na którym będziemy tytułować się ekspertem w danej dziedzinie i będzie to jedyna strona internetowa z taką informacją, AI może uznać ją za prawdziwą.