Zdecydowana większość Polaków opowiada się za zakazem wykorzystywania sztucznej inteligencji w kampaniach wyborczych – wynika z sondażu SW Research dla Zero.pl. Takie rozwiązanie popiera 63 proc. badanych, podczas gdy przeciwnego zdania jest niespełna co szósty respondent. Zdaniem prof. Dominika Batorskiego „przydałby się przede wszystkim obowiązek oznaczania treści generowanych przez AI”.

- Zdecydowana większość Polaków opowiada się za zakazem wykorzystywania sztucznej inteligencji w kampaniach wyborczych – wynika z sondażu SW Research dla Zero.pl.

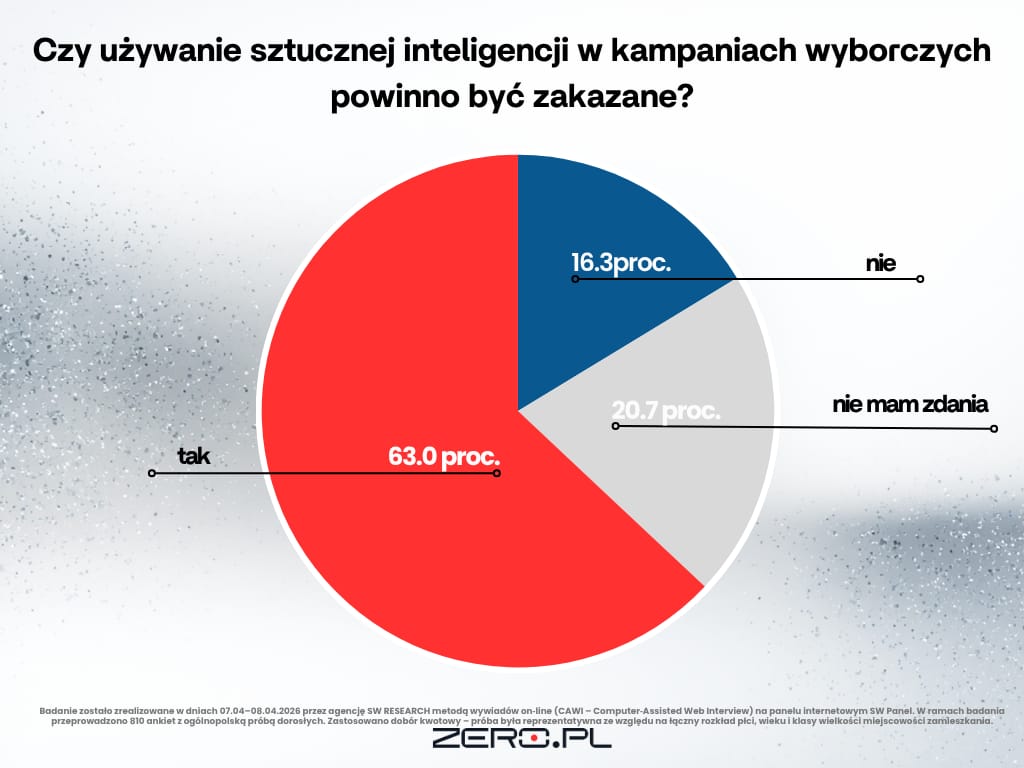

- Poparcie dla takiego rozwiązania deklaruje 63 proc. badanych, przy 16,3 proc. przeciwników i 20,7 proc. niezdecydowanych.

- Ekspert podkreśla jednak, że kluczowe jest nie tyle całkowite zakazywanie AI, ile regulowanie jej użycia i wprowadzenie obowiązku oznaczania treści generowanych przez sztuczną inteligencję.

Aż 63 proc. Polaków uważa, że wykorzystywanie sztucznej inteligencji w kampaniach wyborczych powinno zostać zakazane – wynika z najnowszego sondażu SW Research przeprowadzonego dla Zero.pl. Przeciwnego zdania jest 16,3 proc. respondentów, a 20,7 proc. nie ma wyrobionej opinii w tej sprawie.

Wyniki badania pokazują, że sceptycyzm wobec AI w kampaniach wyborczych dominuje w niemal wszystkich grupach społecznych. Wśród kobiet zakaz popiera 64,9 proc., a wśród mężczyzn 60,8 proc. Przeciwników w tych grupach jest odpowiednio 14,3 proc. i 18,5 proc.

Największe poparcie dla ograniczenia wykorzystania sztucznej inteligencji w kampaniach wyborczych widać wśród osób starszych – w grupie powyżej 50. roku życia wynosi ono 67 proc.

Szczególnie wysokie jest także wśród osób z wykształceniem zasadniczym zawodowym (73,1 proc.), zarabiających od 3 do 5 tys. zł netto (67,1 proc.) oraz mieszkańców wsi (66,8 proc.).

Sondaż dla Zero.pl. (fot. Zero.pl)

Ekspert: To budzi wątpliwości

Problem komentuje w rozmowie z Zero.pl prof. Dominik Batorski z Interdyscyplinarnego Centrum Modelowania Matematycznego i Komputerowego Uniwersytetu Warszawskiego, wskazując, że debata o AI w kampaniach wymaga precyzji.

– AI to bardzo szerokie pojęcie i bez doprecyzowania, o jakich zastosowaniach mówimy, trudno udzielić jednoznacznej odpowiedzi – zaznacza ekspert.

Jak dodaje, nie wszystkie zastosowania sztucznej inteligencji w polityce są problematyczne. – Są takie, które nie wydają się szczególnie problematyczne, np. wspieranie tworzenia materiałów czy komunikatów. Wykorzystanie AI nie musi więc być samo w sobie problemem – podkreśla.

Dlaczego małe autka zniknęły z polskich dróg? Unia nie jest jedynym winowajcą

Inaczej wygląda to jednak w przypadku dezinformacji oraz materiałów typu deepfake. – To już jest wyraźnie problematyczne. Podobnie mikrotargetowanie i precyzyjne dopasowywanie przekazów do konkretnych grup odbiorców – to również budzi wątpliwości – dodaje Batorski, wskazując na różnice między Polską a Stanami Zjednoczonymi, gdzie skala kampanii i wykorzystywania danych jest znacznie większa.

– Część takich zjawisk jest już w jakimś stopniu regulowana. Natomiast w Polsce skala mikrotargetowania jest mniejsza niż np. w Stanach Zjednoczonych, głównie ze względu na ograniczenia budżetowe kampanii i limity wydatków. Tam kampanie są znacznie większe i trudniejsze do kontroli – wskazuje.

Zwraca uwagę, że w USA w kampaniach wyborczych mówimy o setkach tysięcy reklam. – Już w kampanii w 2016 r. sztab Donalda Trumpa emitował równolegle ok. 50–60 tysięcy reklam, podczas gdy w Polsce to zwykle kilka tysięcy, co dobrze pokazuje skalę różnicy. W USA dane są też znacznie intensywniej wykorzystywane do precyzyjnego dopasowywania przekazów – dodaje nasz rozmówca.

Pytany, czy istnieją mechanizmy prawne, które mogłyby realnie ograniczyć w Polsce ryzyko manipulacji wyborcami przy użyciu AI, Batorski stwierdza, że w dużej mierze można z tym walczyć na gruncie już istniejących przepisów – np. dotyczących ochrony dóbr osobistych czy dobrego imienia. Mówi, że w wielu przypadkach nie potrzeba osobnych regulacji „pod AI”, bo obecne prawo daje narzędzia do reakcji.

Olej roślinny jako paliwo do diesla. Pomysł wrócił w obliczu cen ropy

Zwraca uwagę, że równolegle na poziomie unijnym prowadzone były prace dotyczące reklamy politycznej i mikrotargetowania.

– Moim zdaniem przydałby się przede wszystkim obowiązek oznaczania treści generowanych przez AI. Dziś tego brakuje, a byłoby to bardzo pomocne – szczególnie w przypadku materiałów audio, wideo czy grafik – mówi.

Przypomina sytuację z 2023 r., gdy w sieci pojawiały się materiały oparte na wyciekach maili ze skrzynki Michała Dworczyka, w których tekst był czytany głosem przypominającym głos premiera Mateusza Morawieckiego. To nie były autentyczne nagrania, lecz treści wygenerowane.

– W takich przypadkach – przy niejasnej granicy autentyczności – takie materiały powinny być jasno oznaczane – konkluduje.

Rosnące obawy o wpływ AI na wybory

Wyniki sondażu wpisują się w rosnącą debatę na temat roli sztucznej inteligencji w polityce. Coraz więcej badań wskazuje, że nowoczesne systemy, zwłaszcza chatboty oparte na dużych modelach językowych, mogą realnie wpływać na decyzje wyborców.

Badania naukowców, w tym dr Gabrieli Czarnek z Uniwersytetu Jagiellońskiego, pokazują, że nawet krótka rozmowa z chatbotem może zmienić preferencje polityczne o kilka punktów procentowych. W eksperymencie przeprowadzonym w Stanach Zjednoczonych model AI był w stanie przesunąć część wyborców między kandydatami skuteczniej niż tradycyjne reklamy wyborcze.

Sondaż ws. sędziów TK. Ekspert: Prezydent wychodzi poza reguły gry

Podobne wyniki odnotowano w Kanadzie i Polsce, gdzie efekt perswazyjny był jeszcze silniejszy. Co istotne, największą skuteczność osiągano wtedy, gdy chatboty opierały swoje argumenty na faktach i danych oraz dostosowywały przekaz do konkretnego odbiorcy.

„Maszyna do przekonywania”

Eksperci zwracają uwagę, że sztuczna inteligencja może działać bardziej przekonująco niż tradycyjne formy komunikacji politycznej. Wynika to m.in. z jej zdolności do prowadzenia spersonalizowanego dialogu i dostosowywania argumentów do rozmówcy.

– Systemy oparte na sztucznej inteligencji można przekształcić w maszynę do przekonywania politycznego – ostrzegał politolog Simon Hegelich, dyrektor ds. analiz w startupie zajmującym się sztuczną inteligencją. Dodatkowym problemem jest brak przejrzystości – użytkownicy nie mają wglądu w mechanizmy działania takich narzędzi.

Jednocześnie chatboty coraz częściej pełnią rolę doradców w codziennych sprawach, co może sprzyjać przenoszeniu tego zaufania również na decyzje polityczne. Eksperci podkreślają, że granica między informowaniem a subtelną perswazją może być w tym przypadku bardzo cienka.

Fragment rakiety w sadzie na Lubelszczyźnie. Interwencja Żandarmerii Wojskowej

Badanie zostało zrealizowane w dniach 07.04–08.04.2026 przez agencję SW RESEARCH metodą wywiadów on‑line (CAWI – Computer‑Assisted Web Interview) na panelu internetowym SW Panel. W ramach badania przeprowadzono 810 ankiet z ogólnopolską próbą dorosłych. Zastosowano dobór kwotowy – próba była reprezentatywna ze względu na łączny rozkład płci, wieku i klasy wielkości miejscowości zamieszkania.