Shadow AI cicho wkracza do polskich szpitali. Lekarze korzystają z nieautoryzowanych czatbotów, by przetrwać biurokratyczne obciążenia – a dyrektorzy placówek nie mają o tym pojęcia. Skutki mogą być katastrofalne: od wycieków danych po wielomilionowe kary.

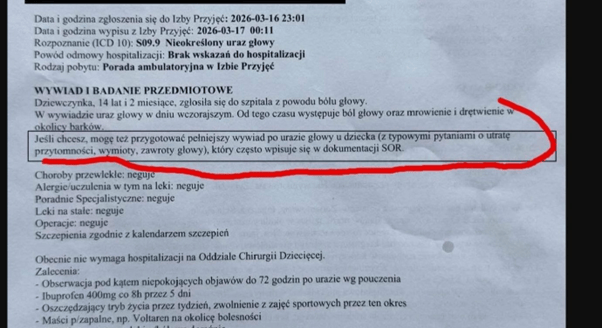

Jest 3:00 nad ranem. Lekarz kończy właśnie dwunastą godzinę wyczerpującego dyżuru, a przed nim wciąż leży sterta dokumentacji medycznej i dziesiąty z kolei, skomplikowany wypis do zredagowania. Pokusa jest ogromna: skopiować surowe notatki, wkleić je do popularnego czatbota w przeglądarce i poprosić o wygenerowanie gotowej epikryzy. Kopiuj, wklej, gotowe. Ulga następuje natychmiast, ale system szpitalny nie odnotowuje tego faktu, a dyrekcja placówki najczęściej nie ma o nim bladego pojęcia.

Tak właśnie rodzi się Shadow AI – zjawisko korzystania przez pracowników z nieautoryzowanych, zewnętrznych narzędzi sztucznej inteligencji, całkowicie poza radarem działu IT. Skala problemu nie jest mała. Według najnowszych badań Wolters Kluwer – 57 proc. pracowników ochrony zdrowia zetknęło się z nieautoryzowanymi narzędziami AI lub ich używało w miejscu pracy. Prawie 20 proc. przyznaje się do bezpośredniego korzystania z takich narzędzi, a ponad 40 proc. wie, że robią to ich koledzy.

W ochronie zdrowia mówimy tu o powszechnej, codziennej praktyce. Lekarze sięgają po te rozwiązania, ponieważ algorytmy genialnie oszczędzają ich czas i ratują przed biurokratycznym wypaleniem. Ponad połowa administratorów i 45 proc. lekarzy przyznaje wprost: używam nieautoryzowanych narzędzi, bo to przyspiesza pracę. Kolejne 40 proc. wskazuje na brak zatwierdzonych alternatyw o porównywalnej funkcjonalności.

Zamykanie na to oczu przez dyrektorów oznacza więc ciche przyzwolenie, które w świetle prawa generuje dla placówek medycznych niewyobrażalne ryzyko. Gdy lekarz na własną rękę wspiera się ogólnodostępnymi modelami językowymi, szpital wystawia się na dwa potężne ciosy.

Halucynacje i brak medycznych podstaw

Komercyjne modele ogólnego przeznaczenia zostały zaprojektowane przede wszystkim jako sprawne generatory tekstu. Za wszelką cenę chcą dostarczyć „dobrze brzmiącą” odpowiedź, przez co mają niebezpieczną tendencję do zmyślania, czyli tak zwanych halucynacji. Potrafią wygenerować perfekcyjnie napisaną, ale merytorycznie błędną diagnozę lub wymyślić nieistniejącą interakcję lekową. W medycynie absolutnie nie ma miejsca na zgadywanie. Bezpieczeństwo pacjenta jest najczęściej wskazywaną obawą związaną z AI w opiece zdrowotnej.

Meta szykuje duże zwolnienia. Nawet 20 proc. pracowników może stracić pracę

Wspieranie lekarzy w procesie diagnostycznym wymaga dostarczenia im narzędzi opartych wyłącznie na twardej medycynie i dowodach (EBM). Doskonałym, pozytywnym przykładem z polskiego rynku jest tu system Medico od Państwowego Zakładu Wydawnictw Lekarskich, który generuje odpowiedzi, bazując wyłącznie na sprawdzonych, certyfikowanych źródłach medycznych. Taka profesjonalna integracja i korzystanie z dedykowanych rozwiązań skutecznie ucina ryzykowne poszukiwania w otwartym, niezweryfikowanym internecie.

Prywatność pacjenta i utrata suwerenności technologicznej

Kopiowanie historii choroby pacjenta do amerykańskich chmur obliczeniowych wprost łamie tajemnicę lekarską. Nawet po usunięciu z dokumentu nazwiska, pozostawienie rzadkiej jednostki chorobowej, wieku i historii leczenia sprawia, że pacjent wciąż pozostaje identyfikowalny. W ten sposób oddajemy najbardziej wrażliwe dane obywateli w ręce zagranicznych korporacji, dobrowolnie zrzekając się naszej suwerenności technologicznej.

Pielęgniarki pod presją? OZZPiP alarmuje ws. dokumentacji i braków kadrowych

Jeśli placówka decyduje się na korzystanie z zewnętrznych systemów, absolutnym inżynieryjnym minimum musi być zastosowanie systemów pośredniczących (tzw. proxy). Będą one twardo anonimizować i pseudonimizować dane w locie, zanim te w ogóle opuszczą infrastrukturę szpitala. Przykładem takiego narzędzia jest Presidio czy AnoniminNER, mały model AI działający nawet w przeglądarce, który wykrywa dane osobowe i anonimizuje je w locie. Najbezpieczniejszym, docelowym wyjściem pozostają jednak lokalne modele LLM, instalowane fizycznie na serwerach placówki. Dzięki architekturze on-premise szpital zyskuje pełne bezpieczeństwo, prywatność, niezależność, a dane pacjenta nigdy nie wychodzą za szpitalne mury.

Dyrektor nie może powiedzieć: „To lekarz wpisał, my nie wiedzieliśmy”

W przypadku wycieku danych dyrektor szpitala nie może dziś rozłożyć rąk i zasłonić się niewiedzą. Brak kontroli nad używaniem AI przez personel stanowi rażące zaniedbanie zarządcze, a wokół zarządów zaciska się właśnie potężny gorset legislacyjny.

Z jednej strony mamy ustawę o Krajowym Systemie Cyberbezpieczeństwa, która wprost uznaje szpitale za operatorów usług kluczowych. Nakłada ona obowiązek wdrożenia systemu zarządzania bezpieczeństwem, raportowania incydentów i poddawania się regularnym audytom, a za błędy grożą kary do 200 tys. zł.

Sytuację drastycznie zaostrza wchodząca na nasze podwórko europejska dyrektywa NIS2. Obejmuje ona nawet mniejsze placówki i laboratoria, wprowadzając osobistą odpowiedzialność kierownictwa za cyberbezpieczeństwo oraz konieczność zarządzania ryzykiem w łańcuchu dostaw. Tutaj kary rosną do astronomicznych 10 mln euro lub 2 proc. obrotu, a incydenty – takie jak wyciek wrażliwych danych przez darmowego bota – trzeba będzie zaraportować w zaledwie 24 godziny.

Równolegle szpitale muszą mierzyć się z bezwzględnymi wymogami RODO, klasyfikującymi dane medyczne jako kategorię szczególną. Wymaga to wdrożenia środków proporcjonalnych do ryzyka, w tym zaawansowanej pseudonimizacji. Naruszenia prywatności muszą trafić do UODO w ciągu 72 godzin, a widmo kar sięgających 20 mln euro spędza sen z powiek dyrektorom.

Jakie kompetencje będą kluczowe w erze sztucznej inteligencji?

Całość domyka rozporządzenie ministra zdrowia, które bezwzględnie wymaga zachowania integralności i poufności Elektronicznej Dokumentacji Medycznej (EDM). Każdy wpis musi pozwalać na precyzyjną identyfikację autora, co jest kluczowe przy integracji z państwowymi platformami takimi jak P1 czy e-Recepta. W dobie zjawiska Shadow AI żaden audyt tak obwarowanego systemu nie zakończy się wynikiem pozytywnym.

AI w szpitalu musi być procesem

Używanie sztucznej inteligencji na oddziale absolutnie nie może opierać się na tym, że każdy lekarz na własną rękę testuje w przeglądarce kolejne nowinki. Wdrożenie AI wymaga uporządkowania na poziomie całej organizacji. Zgodnie z unijnym aktem o sztucznej inteligencji (AI Act) systemy te muszą być układane w rygorystyczny proces. Placówka musi audytować działania, bezpiecznie logować zapytania i precyzyjnie wiedzieć, kto i w jakim celu korzysta z technologii wspierających.

Co dalej z cenami żywności w Polsce? Wojna na Bliskim Wschodzie stwarza ryzyko wzrostu

Ignorowanie zjawiska Shadow AI przypomina spacer po polu minowym. Czas przestać udawać, że lekarze omijają sztuczną inteligencję szerokim łukiem. Pokusa szybkiego wygenerowania dziesiątego wypisu po 12 godzinach wyczerpującego dyżuru jest i zawsze będzie zbyt silna. Zamiast zamykać oczy na problem, szpitale muszą pilnie wdrożyć lokalne, bezpieczne i systemowe rozwiązania. Tylko w ten sposób dadzą personelowi niezbędną oszczędność czasu, chroniąc jednocześnie pacjentów i budżet placówki.